Nowe sensory od Sony

Firma Sony zaprezentowała niedawno dwa sensory pełnoklatkowe: IMX366AJK o rozdzielczości 44.7 megapikseli oraz IMX455AQK - 61-megapikselowy.

Sony IMX366AJK to 44.72-megapikselowy sensor CMOS który może rejestrować obraz nieruchomy o rozdzielczości 8204x5476 pikseli przy 26.15 kl/s. Jeśli chodzi o wideo, mamy 12-bitowy zapis 8K DCI z prędkością do 60 kl/s i 12-bitowy zapis 4K DCI z prędkością do 120 kl/s. Układ ma funkcję elektronicznej pierwszej kurtyny migawki. Przeznaczony jest do wykorzystania w aparatach cyfrowych i kamerach konsumenckich. Karta produktu dostępna jest tutaj.

Z kolei sensor Sony IMX455AQK przypomina ten zastosowany w bezlusterkowcu A7R V. Przy wykorzystaniu 16-bitowego konwertera A/C, obraz w pełnej rozdzielczości (9576x6388 pix) może być zapisywany przy 3.9 kl/s. Gdy ograniczymy przetwarzanie do 12 bitów, tempo to rośnie do 18 kl/s. Jeśli chodzi o wideo, może on rejestrować obraz w 8K przy 30 kl/s oraz 4K przy 60 kl/s. Podobnie jak sensor IMX366AJK, ten także ma znaleźć zastosowanie w aparatach cyfrowych i kamerach konsumenckich. Jego karta produktu dostępna jest tutaj.

Komentarz można dodać po zalogowaniu.

Zaloguj się. Jeżeli nie posiadasz jeszcze konta zarejestruj się.

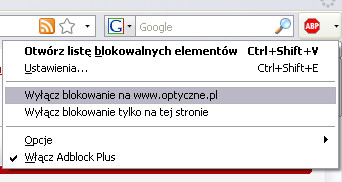

Optyczne.pl jest serwisem utrzymującym się dzięki wyświetlaniu reklam. Przychody z reklam pozwalają nam na pokrycie kosztów związanych z utrzymaniem serwerów, opłaceniem osób pracujących w redakcji, a także na zakup sprzętu komputerowego i wyposażenie studio, w którym prowadzimy testy.

Optyczne.pl jest serwisem utrzymującym się dzięki wyświetlaniu reklam. Przychody z reklam pozwalają nam na pokrycie kosztów związanych z utrzymaniem serwerów, opłaceniem osób pracujących w redakcji, a także na zakup sprzętu komputerowego i wyposażenie studio, w którym prowadzimy testy.

"Przy wykorzystaniu 16-bitowego konwertera A/C"... o! i to jest wiadomosc :)

A7VI i A7RVI coming soon

> Przy wykorzystaniu 16-bitowego konwertera A/C, obraz w pełnej rozdzielczości (9576x6388 pix) może być zapisywany przy 3.9 kl/s.

tu widać jaki jest problem z tymi bitami, np. Fujifilm GFX 100, z większą matrycą (o 2/3) potrafił "wyciągnąć" 5 kl/s, czyli trochę lepiej, ale też "bez szału"; a Optyczni w teście stwierdzają, że zysk w dynamice tonalnej z 16 bitów, w stosunku do 14, jest minimalny;

ale może pozwoli to konkurować z Hasselbladem i PhaseOne?

BTW, może to jest przyczyna trzymania się przez OMDS (czyli system m4/3) 12 bitów? - wystarcza do dobrych obrazków a jednak zwiększa ogólną wydajność aparatu;

@JdG: 3.9 kl/s to wiele więcej niż potrzeba, żaden problem, zwłaszcza przy 61mpx. Można się spierać czy te bity widać czy nie widać i w jakich warunkach. Optyczni robią w JPG z rozmyciem, więc mają specyficzny pogląd na sprawę. Natomiast jak tylko zaczniesz obróbkę w PS to natychmiast odczujesz różnicę tych dodatkowych bitów. Nie bez powodu Hassel i P1 tak mają i słono za to kasują. Tu jest szansa na aparat "dla ludu" który jeszcze bardziej się zbliży jakością obrazka do topowych sprzętów. Co do m43 to bez komentarza, to nie ta półka.

@cube

"Optyczni robią w JPG z rozmyciem, więc mają specyficzny pogląd na sprawę."

Co robią takiego? Analiza 8bitowego jpg nie miałaby najmniejszego sensu. Do tego rozmyte? Optyczni analizują Rawy konwertowane do 16 bitów.

Zgodzę się, że w edycji większy zakres tonalny coś wnosi, ale co dalej? Dysponujesz 16 bitowym monitorem by widzieć różnicę w przejściach tonalnych w stosunku do olympusa? Nie wyobrażam sobie profesjonalnych zdjęć, które trzeba edytować w stopniu wymagającym 16bitów. To raczej tyczy się nieudanych zdjęć- mocno niedoświetlone przy rozjaśnianiu traci na zakresie. Oczywiście zapisujesz wszystkie zdjęcia w 16 bitowym TIFF jak rozumiem?

@JdG

"BTW, może to jest przyczyna trzymania się przez OMDS (czyli system m4/3) 12 bitów? - wystarcza do dobrych obrazków a jednak zwiększa ogólną wydajność aparatu;"

Nikon stosuje 12bitowy zapis by właśnie przyspieszyć pracę - szybsza seria.

Ten 44 mpix to być może do nowego A9 III

Chociaż jeśli nie mają architektury warstwowej to raczej nie do puszek z najwyższej półki

Informacja oznacza, że matryce są dostępne w sprzedaży.

Chyba wszystkie współczesne telewizory i wiele monitorów i telefonów ma już HDR. Zapomnijcie o 8 bitowych jpeg'ach.

RobKoz zauważ że wiele tańszych modeli szczyci się HDR a matryce mają 8 bitową. Wyświetlacze aparatów foto też dupy nie urywają, a sprzęty te obrazują w co najmniej 12 bitach.

Problem jeszcze w tym, że monitory 10 bitowe są ciągle towarem luksusowym, a HEIF-y mało popularne. Jedynie Apple robi w tym temacie robotę i wycofuje całkowicie 8bitowe wyświetlacze oraz promuje 10 bitowe foto/wideo. Ale cena ich sprzętów jest często wyższa od ceny PC z wyświetlaczem 10 bitowym. A, dodać jeszcze trzeba, że dopiero od niedawna NVIDIA wprowadza małymi kroczkami w linii konsumenckiej wsparcie dla obrazowania 10 bitowego. Windows ciągle ma problemy...

Szabla: ale to że są w sprzedaży chyba nie oznacza że Sony nie będzie ich wykorzystywać we własnych puszkach?

@Maciox "Nie wyobrażam sobie profesjonalnych zdjęć, które trzeba edytować w stopniu wymagającym 16bitów"

Może problemem jest brak wyobraźni?

Nikt Ci nie broni strzelać olkiem seriami.

Nie rozumiem tylko skąd to zacietrzewienie, że wszystko czego nie ma w olku jest niepotrzebne, bez sensu i w ogóle nie widać różnicy.

To że sam nie widzisz lub nie chcesz zobaczyć roznicy nie znaczy że jej nie ma. No właśnie, może to brak wyobraźni...

@ad1216

Nie oznacza. Oznacza to, że wkrótce pojawi się aparat z matrycą 61 Mp, którego nie wyprodukuje Sony.

Chciałem z rana napisać, że podejrzewam, co to za aparat, ale teraz to chyba już nawet wiem... ;) A jeśli tak, to się nie dziwię, że ma być wielkości lustrzanki... Z takim sensorem!

PS

Czy odczyt 16-to bitowy oznacza, że piksele będą miały pojemność ≥ 2¹⁶ e⁻?

> Chyba wszystkie współczesne telewizory i wiele monitorów i telefonów ma już HDR. Zapomnijcie o 8 bitowych jpeg'ach. [RobKoz]

ale jaki związek ma sposób kodowania koloru przez aplikacje z HDR? jotpegi nie znikną, bo przecież większość obrazków jest tak zapisana w aparatach foto i wątpię, żeby ktoś zadał sobie trud ich konwersji na inny format; jotpegi są po prostu praktyczne; 8 bitów na kolor to ponad ich 16 mln, 10 bitów to ponad miliard; nikt i tak nie rozróżnia takiej ilości kolorów, choć je widzi, oczywiście, jakoś, nie każdy tak samo, a raczej pewnie każdy deczko inaczej.

co do 8-bitowości, to na razie prawie wszystko w obrazowaniu jest 8-bitowe, z wyjątkiem części profesjonalnej i artystycznej działalności; video powoli przechodzi na 10-bitowe kodowanie, monitory są dalej 8-bitowe, są już kodujące kolor w 10 bitach, ale ich ceny zaczynają się powyżej 5 tys. PLN (a chyba nawet powyżej 10 tys.), reszta 10-bitowców obecnych na rynku to sztuczki sprzętowo-software'owe;

to oczywiście nie znaczy że te wszystkie bity powyżej 8 (jak w jotpegach i monitorach), czy 12-tu (jak w "Olku" i m4/3 przeważnie) nie mają sensu; z pewnością mają, jednak to już najczęściej coś w rodzaju złoconych, specjalnych kabli dla audiofilów;

aczkolwiek pewnie są i jakieś realne korzyści; w video 10 bitów to jednak odczuwalny postęp dla tych, którzy traktują to bardziej serio;

> Nie rozumiem tylko skąd to zacietrzewienie, że wszystko czego nie ma w olku jest niepotrzebne, bez sensu i w ogóle nie widać różnicy. [cube]

jeżeli ktoś tu jest zacietrzewiony, to najpewniej Ty - w "olku" akurat jest wszystko, co w innych urządzeniach, czasami nawet więcej niż w innych; przetwornik koduje co prawda 12-bitowo, ale to akurat wystarcza; zawsze można zapisać RAW i potem sobie do woli w bitach żonglować, jak kto ma taką potrzebę.

@cube

"Może problemem jest brak wyobraźni? "

Może. Tyle, że wyobraźnia przydaje się w przypadku nieudanych zdjęć, gdy trzeba się domyślać co zostało uwiecznione.

"To że sam nie widzisz lub nie chcesz zobaczyć roznicy nie znaczy że jej nie ma. No właśnie, może to brak wyobraźni... "

Problem w tym, że nawet tak dobra matryca jak w GFX-ie jest na tyle niedoskonała, by przetwarzanie 16 bitowe było zbędne. Popatrz na zdjęcia z jednolitymi motywami jak błękitne niebo - w dużym powiększeniu nie jest gładkie o płynnym przejściu tonalnym, a jest to niemal deseń. Niestety niejednorodność diod, wzmacniania ich potencjału w tym szumu i dalszego przetwarzania w tym niedokładność przetwornika A/C jest tak duża, że taki jednolity by się wydawało motyw składa się z pikseli różniących się wartością rzędu kilku procent. Jest to zjawisko analogiczne do przejść tonalnych tylko w bardzo małej skali. Do tego dochodzi używanie czułości większych niż natywna gdy obraz natywnej czułości jest programowo rozjaśniany, a rozjaśnienie o 1EV zabiera 1bit z zakresu tonalnego. Co z tego, że potem procesor dokonuje interpolacji by zapisać obraz w 16bitach?

Dla mnie taki mozaikowy obraz jest do bani niezależnie czy z GFX-a czy olympusa i zawsze się ratuję demozaikowaniem w DxO PL, które wygładza również słabe przejścia tonalne przy dużych czułościach.

Nie oszukujmy się, bo równie dobrze mogę z mojego R7 interpolować rawa do 16bitów, tylko co to da?

Zauważ jeszcze, że GFX 100s daje rawy 16bitowe, a dynamicznie lepsza matryca z GFX50s ma przetworniki 14bitowe...

Dlatego uważam, że 12 bitowe przetwarzanie w olympusach nie jest tak tragicznym rozwiązaniem jak uważasz ("Co do m43 to bez komentarza"@cube) skoro i tak potrzeba ten obraz demozaikować.

@JdG

O ile w większości przypadków 8 bitów na kanał wystarczy, to w niektórych sytuacjach może być niewystarczające - niemal 17milionów kolorów ale tylko 256 odcieni szarości. Gorsze jest jednak to, że w jpg nie masz dużej kontroli nad kompresją. W heif masz pełną. Ja się dużo namęczyłem w niektórych sytuacjach by uzyskać jakiś efekt, a i tak niezadowalający. W przypadku jpg akurat demozaikowanie daje często opłakane rezultaty bo się potem okazuje, że przy jakości ustawionej na maksimum kodek i tak zapisuje ci niebo na pół kadru w kilku bajtach. Zdjęcie zaszumione może mieć rozmiar 10MB i to samo przy tych samych ustawieniach po odszumieniu i demozaikowaniu może mieć 2,5MB. Kompresja wiadomo jak wygląda. Niestety publikowanie w sieci jeszcze długi czas będzie głównie w jpg, choć uważam, że nawet PNG jest ciekawszym formatem, dającym większą kontrolę.

> W heif masz pełną. [Maciox]

kontrolę? w jpg też masz jakąś kontrolę, w końcu Large super fine (L SF) w Olympusie to coś koło 2/3 RAW; oczywiście nie upieram się, że to jest super, ten heif to nowy i wyraźnie lepszy patent, ale np. Olympus jeszcze go nie zaimplementował; pożytki z niego są raczej "na przyszłość", zważywszy różne ograniczenia sprzętowe; jotpeg jest po prostu ciągle najpowszechniejszy i w miarę dobry, to coś jak VHS w video; na szczęście postęp technologii jest ciągły i kiedyś (jak stanieją matryce z 10-bitowym kolorem) nastąpi zmiana;

> Zdjęcie zaszumione może mieć rozmiar 10MB i to samo przy tych samych ustawieniach po odszumieniu i demozaikowaniu może mieć 2,5MB.

obrabiasz jotpegi?! to ryzykowne zajęcie z uwagi na kompresję; u mnie 2,5 MB to ma tzw. "dark" (z matrycy 16 MB), czyli czarny kadr; na szczęście Photoshop i Gimp przekładają taki obrazek na własny format i dopiero po edycji można to eksportować z powrotem do jpg; inaczej to prosta droga do degradacji obrazka (kompresja stratna);

> Niestety publikowanie w sieci jeszcze długi czas będzie głównie w jpg, choć uważam, że nawet PNG jest ciekawszym formatem, dającym większą kontrolę.

Niestety, chyba tak; PNG to format bezstratny, tylko obrazki są jednak nieco większe (z 2x minimum); nb. - w kwestii "nieśmiertelnego jotpega" - od jakichś 20 lat istniej format jpg2000 (czy jakoś podobnie), czyli jpg bezstratny, w dodatku, bezpłatny i otwarty, a mimo to nigdy nie spotkałem obrazków w tym formacie;

a nie wyczerpuje on wcale zjawiska otwartych i dobrych formatów plików graficznych;' sprawa nie jest łatwa - to chyba jak z VHS - musi jakiś przełom technologiczny nastąpić, żeby "zabić" jpg.

poza tym PNG to też 8 bitów na kolor;

@JdG

"obrabiasz jotpegi"

Nie, nie pisałem bo myślałem że to oczywiste, ale obie wersje uzyskałem z RAW-a w DxO PL5.

Mało prawdopodobne że są to faktycznie pixele matrycy.

Raczej jak w Olympusach, gdzie wszystkie matryce mają 5 mpx w rzeczywistości, są to rozszerzenia programowe, wirtualne.

Czy dobrze widzę, że Festiwal w Łochowie jest odwołany?

@PiastII Chrobry

Rozwiń temat. Bo nie wiem czy uważasz, że dla jednego piksela są przypisane 4 fotodiody czy coś innego?

Bo jeśli tak, to ten prosty układ filtrów Bayer'a nie jest aż taki prosty i jeśli się dobrze przyjrzysz, zobaczysz, że jest tam więcej czwórek fotodiod do uśredniania (dla ułatwienia dodam, że każda fotodioda służy czterem osobnym obliczeniom).

@Maciox

"Zgodzę się, że w edycji większy zakres tonalny coś wnosi, ale co dalej? Dysponujesz 16 bitowym monitorem by widzieć różnicę w przejściach tonalnych w stosunku do olympusa?"

A słyszałeś o czymś takim jak kompresja dynamiki? To że nośnik wyjściowy ma jakiś ograniczony zakres nie znaczy, że nie można spożytkować większego zakresu wejściowego. A co do Olka, to tam dobrze widać ograniczenia 12 bit.

@lord13

Nie jestem przeciwnikiem 16 bitów, ale nawet w testach optycznych matryca z x-t4 wychodzi podobnie do tej z gfx 100 bo podobna gęstość pikseli.